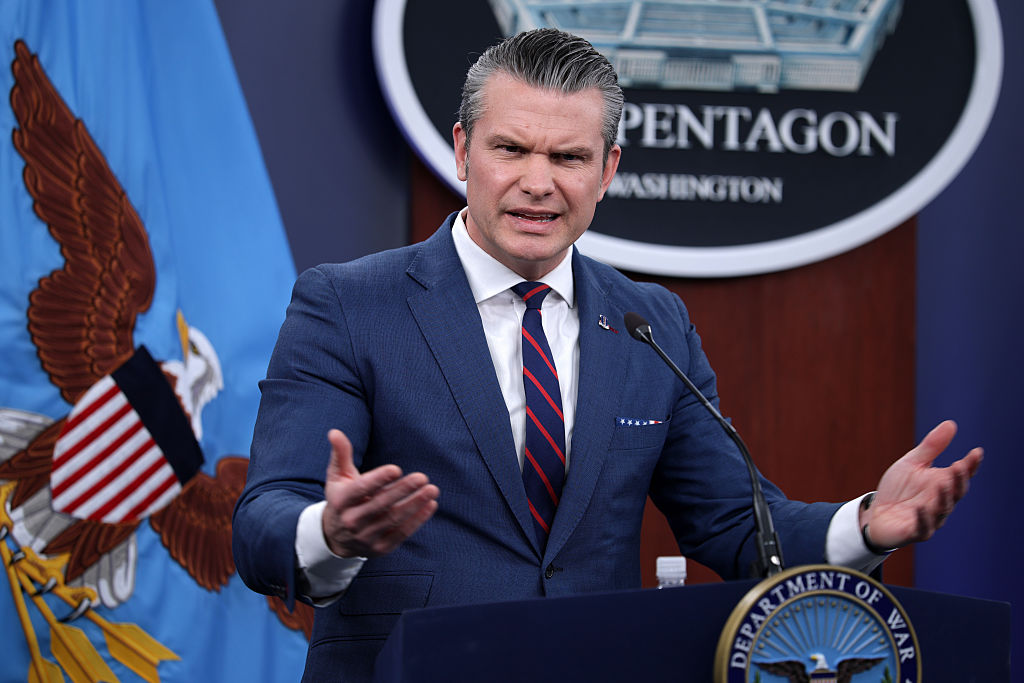

El Departamento de Defensa de Estados Unidos afirmó el martes por la noche que Anthropic representa un “riesgo inaceptable para la seguridad nacional”, marcando la primera respuesta formal de la agencia a las demandas judiciales presentadas por la empresa de inteligencia artificial. La declaración surge en medio de una controversia legal que comenzó cuando el Secretario de Defensa Pete Hegseth designó a la compañía como un riesgo en la cadena de suministro el mes pasado.

Según documentos judiciales presentados en un tribunal federal de California, el Pentágono expresó su preocupación de que Anthropic podría “intentar desactivar su tecnología o alterar preventivamente el comportamiento de su modelo” durante operaciones militares críticas. Como parte de sus demandas, Anthropic había solicitado al tribunal bloquear temporalmente la aplicación de esta designación por parte del DOD.

El conflicto entre Anthropic y el Pentágono por el uso militar de inteligencia artificial

El núcleo del argumento del Departamento de Defensa, presentado en un expediente de 40 páginas, señala el riesgo de que la empresa pudiera interferir con sistemas críticos si considera que se están cruzando sus “líneas rojas corporativas”. Esta preocupación está relacionada directamente con las restricciones que Anthropic intentó imponer sobre el uso de su tecnología.

El verano pasado, Anthropic firmó un contrato de 200 millones de dólares con el Pentágono para implementar su tecnología dentro de sistemas clasificados. Sin embargo, durante negociaciones posteriores sobre los términos del acuerdo, la compañía estableció condiciones específicas sobre cómo podría utilizarse su inteligencia artificial en contextos militares.

Restricciones éticas y la postura de Anthropic sobre armas letales

Según informes del caso, Anthropic manifestó que no deseaba que sus sistemas de IA fueran utilizados para vigilancia masiva de ciudadanos estadounidenses. Additionally, la empresa indicó que su tecnología no estaba preparada para su uso en decisiones de selección de objetivos o disparo de armas letales.

El Pentágono respondió argumentando que una empresa privada no debería dictar cómo las fuerzas armadas utilizan la tecnología adquirida. Esta posición refleja una tensión más amplia en la industria tecnológica sobre la responsabilidad corporativa en el desarrollo de inteligencia artificial para aplicaciones militares.

Apoyo de la industria tecnológica a Anthropic

Múltiples organizaciones se han pronunciado contra el trato del DOD hacia Anthropic, argumentando que el departamento simplemente podría haber terminado el contrato en lugar de designar a la empresa como un riesgo de seguridad nacional. La controversia ha generado un debate significativo sobre los límites del control gubernamental sobre empresas tecnológicas.

Varias compañías tecnológicas y sus empleados, incluyendo representantes de OpenAI, Google y Microsoft, han presentado escritos de amicus curiae en apoyo de Anthropic. Meanwhile, grupos de derechos legales también se han unido para defender la posición de la compañía.

Acusaciones de violación a la Primera Enmienda

En sus demandas, Anthropic acusó al Departamento de Defensa de infringir sus derechos bajo la Primera Enmienda de la Constitución estadounidense. La empresa argumenta que está siendo castigada por motivos ideológicos, lo que representa una preocupación significativa sobre la libertad de expresión corporativa y los límites del poder ejecutivo.

La compañía no respondió de inmediato a solicitudes de comentarios sobre la presentación más reciente del DOD. Esta falta de respuesta pública sugiere que la empresa podría estar enfocándose en preparar sus argumentos para el procedimiento judicial próximo.

Una audiencia sobre la solicitud de Anthropic para obtener una orden judicial preliminar está programada para el próximo martes. Este procedimiento será crucial para determinar si el tribunal ordenará al Departamento de Defensa suspender temporalmente la designación mientras se resuelve el caso completo. El resultado podría establecer un precedente importante sobre hasta qué punto las empresas de inteligencia artificial pueden establecer límites éticos en el uso militar de sus tecnologías, y cómo el gobierno federal puede responder cuando dichas restricciones entran en conflicto con objetivos de seguridad nacional.