Una coalición bipartidista de expertos ha presentado la Declaración Pro-Humana, un marco integral para la regulación de inteligencia artificial que busca establecer límites claros al desarrollo de IA en un momento crítico para Estados Unidos. El documento, firmado por cientos de especialistas y ex funcionarios, propone cinco pilares fundamentales para garantizar que la inteligencia artificial expanda el potencial humano en lugar de reemplazarlo, según declaraciones de sus organizadores.

La iniciativa cobra relevancia especial tras el conflicto entre el Pentágono y Anthropic a finales de febrero, cuando el Secretario de Defensa Pete Hegseth designó a la empresa como “riesgo para la cadena de suministro” después de que rechazara conceder al Departamento de Defensa uso ilimitado de su tecnología de IA.

Marco para la Regulación de Inteligencia Artificial

La Declaración Pro-Humana establece prohibiciones específicas sobre el desarrollo de superinteligencia hasta que exista consenso científico sobre su seguridad. Además, exige interruptores obligatorios en sistemas potentes y prohíbe arquitecturas capaces de autorreplicación, automejora autónoma o resistencia al apagado, según el texto publicado.

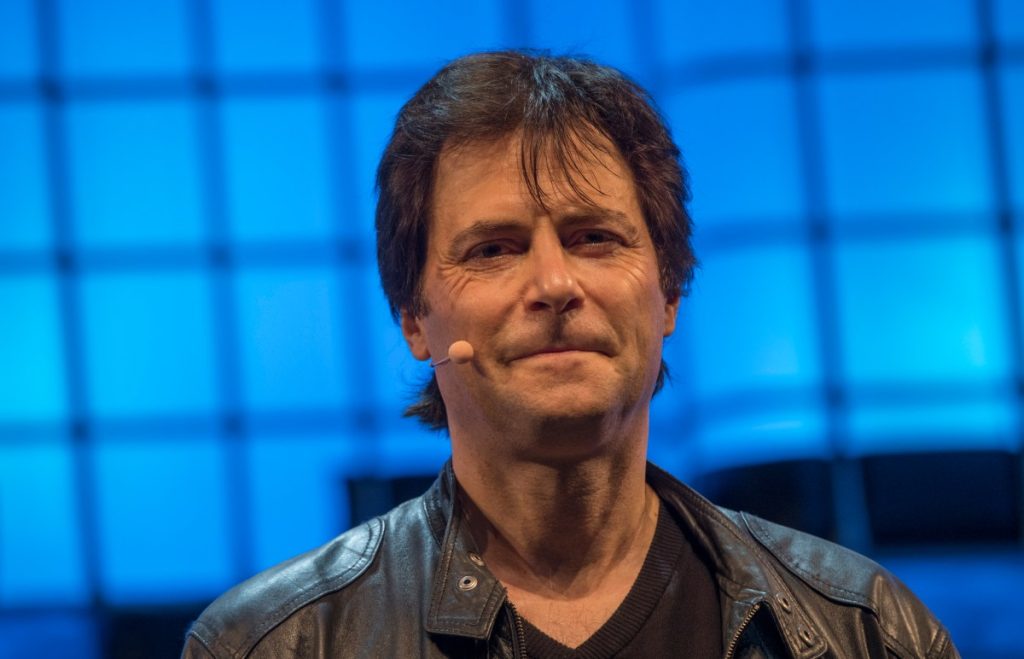

Max Tegmark, físico del MIT e investigador de IA que ayudó a organizar el esfuerzo, indicó que las encuestas recientes muestran que el 95% de los estadounidenses se opone a una carrera sin regulación hacia la superinteligencia. Este cambio en la opinión pública ocurrió en apenas cuatro meses, señaló en entrevista.

Contexto del Conflicto entre Pentágono y Empresas de IA

El incidente con Anthropic expuso la ausencia de normas coherentes que rijan el desarrollo de inteligencia artificial en el ámbito gubernamental. Horas después de la designación de Anthropic como riesgo, OpenAI alcanzó un acuerdo con el Departamento de Defensa que expertos legales consideran difícil de hacer cumplir de manera significativa.

Dean Ball, investigador senior de la Foundation for American Innovation, declaró a The New York Times que este no es simplemente una disputa contractual, sino la primera conversación nacional sobre el control de sistemas de IA. El episodio reveló el costo de la inacción del Congreso en materia de regulación tecnológica.

Cinco Pilares de la Declaración

El documento plantea mantener a los humanos a cargo de decisiones críticas, evitar la concentración de poder, proteger la experiencia humana, preservar las libertades individuales y establecer responsabilidad legal para las empresas de IA. Estas medidas buscan prevenir que el poder se acumule en instituciones sin rendición de cuentas y sus máquinas.

La declaración distingue entre dos caminos posibles: uno donde los humanos son suplantados primero como trabajadores y luego como tomadores de decisiones, y otro donde la inteligencia artificial amplía masivamente el potencial humano. La elección del segundo escenario depende de la implementación efectiva de los cinco pilares propuestos.

Protección de Menores como Punto de Presión

Tegmark identificó la seguridad infantil como el punto de presión más probable para romper el impasse actual en Washington. La declaración exige pruebas obligatorias antes del despliegue de productos de IA, particularmente chatbots y aplicaciones dirigidas a usuarios jóvenes, evaluando riesgos como ideación suicida, agravamiento de condiciones de salud mental y manipulación emocional.

El investigador del MIT trazó una analogía con las regulaciones farmacéuticas, argumentando que así como la FDA no permite el lanzamiento de medicamentos hasta confirmar su seguridad, debería existir un marco similar para la IA. Sugirió que las leyes existentes contra el acoso infantil deberían aplicarse igualmente cuando las máquinas cometen tales actos.

Apoyo Bipartidista sin Precedentes

La declaración cuenta con firmantes que raramente coinciden políticamente, incluyendo a Steve Bannon, ex asesor del presidente Trump, y Susan Rice, ex Asesora de Seguridad Nacional del presidente Obama. También firmaron el ex presidente del Estado Mayor Conjunto Mike Mullen y líderes religiosos progresistas.

Tegmark explicó que el consenso surge del reconocimiento compartido de que todos son humanos. Cuando la elección se plantea entre un futuro para humanos o uno para máquinas, naturalmente eligen el mismo lado, independientemente de sus diferencias políticas.

Se espera que el documento genere presión legislativa en los próximos meses, particularmente en torno a la protección infantil como punto de entrada para una regulación más amplia. Tegmark anticipa que una vez establecido el principio de pruebas previas al lanzamiento para productos infantiles, el alcance se ampliará para incluir pruebas sobre riesgos de bioterrorismo y amenazas a la seguridad nacional. Sin embargo, permanece incierto si el Congreso actuará antes de que surjan crisis adicionales en el sector de inteligencia artificial.